Sprachmodelle können eine Vielzahl von Aufgaben erfüllen, darunter das Schreiben von Aufsätzen und das Zusammenfassen von Artikeln, Fragen zu beantworten, Bildunterschriften zu verfassen und sogar Musik zu komponieren. Aber nicht alle sind gleich. Es gibt verschiedene Arten von Sprachmodellen, jedes mit seinen eigenen Stärken und Schwächen. In diesem Blogpost werden wir uns mit den drei wichtigsten Arten befassen, die sich als vorherrschend herauskristallisiert haben, und wir werden erörtern, warum und wie sie für uns von großem Nutzen sein können.

Table of Contents

ToggleGroße Sprachmodelle

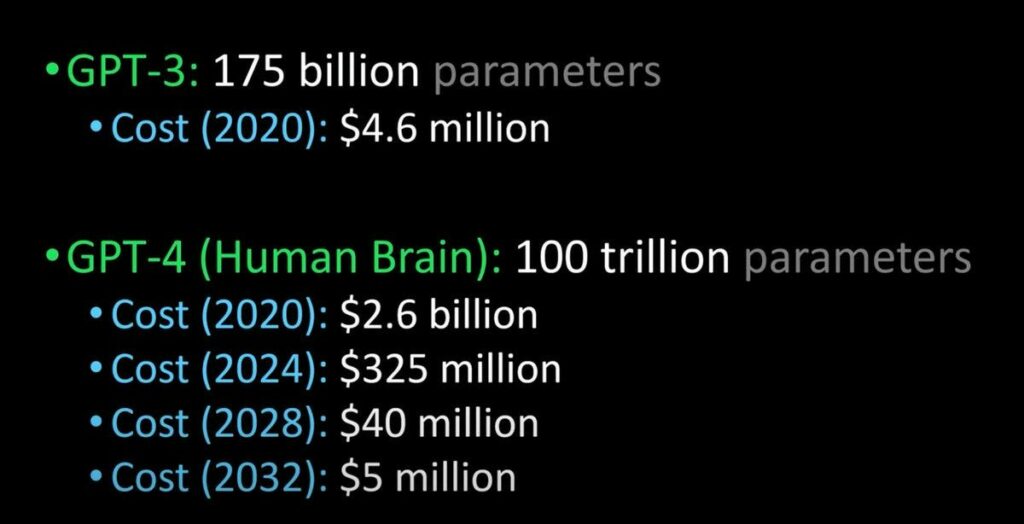

Große Sprachmodelle sind die Giganten in der Welt der Sprachmodellierung. Sie werden auf riesigen Mengen von Textdaten, manchmal Milliarden von Wörtern, aus verschiedenen Quellen wie Büchern, Websites, sozialen Medien und Nachrichtenartikeln trainiert. Sie verwenden tiefe neuronale Netze mit Hunderten von Schichten und Milliarden oder Billionen von Parametern, um die statistischen Muster der natürlichen Sprache zu lernen.

Einige Beispiele für große Sprachmodelle sind GPT-3 und -4, BERT und T5. Diese Modelle sind in der Lage, kohärente und vielfältige Texte zu fast jedem Thema zu erstellen, wenn eine geeignete Aufforderung vorliegt. Sie sind auch in der Lage, mehrere Aufgaben ohne weiteres Training auszuführen, indem sie Techniken zur Aufforderung in wenigen Augenblicken anwenden. GPT kann Filmkritiken schreiben, Matheaufgaben lösen, Prüfungen auf College-Niveau ablegen und sogar die Bedeutung eines Wortes erkennen.

Große Sprachmodelle sind beeindruckend, aber sie haben auch ihre Grenzen. Erstens benötigen sie viele Rechenressourcen zum Trainieren und Ausführen, was sie teuer und für viele Nutzer unzugänglich macht. Zweitens verbrauchen große Sprachmodelle viel Energie, was zu Umweltbedenken führt. Und schließlich können sie Verzerrungen und Fehler aus ihren Trainingsdaten übernehmen, was leicht zu schädlichen oder irreführenden Ergebnissen führt.

Feinabgestimmte Sprachmodelle

Feinabgestimmte Sprachmodelle sind die Spezialisten in der Welt der Sprachmodellierung. Sie werden für eine bestimmte Aufgabe oder einen bestimmten Bereich trainiert, wobei eine kleinere Menge von Daten verwendet wird, die für die Aufgabe oder den Bereich relevant sind. Sie verwenden vortrainierte große Sprachmodelle als Ausgangspunkt und passen sie dann an die Aufgaben- oder Domänendaten an.

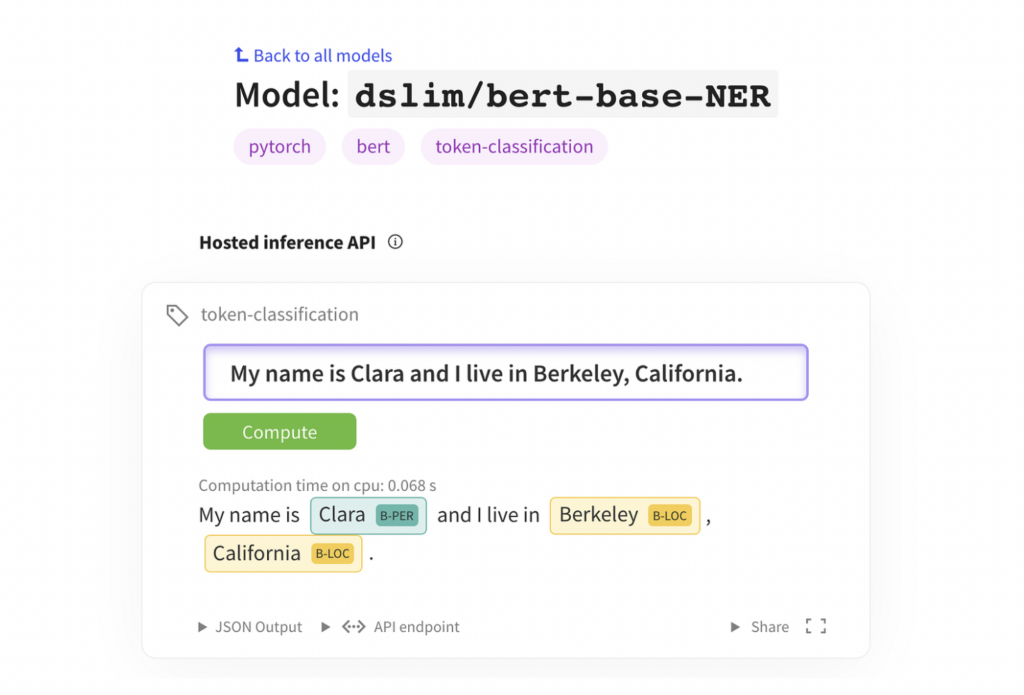

Einige Beispiele für fein abgestimmte Sprachmodelle sind OpenAI Codex, GPT-3 Ada und BERT-base-NER. Diese Modelle können Aufgaben erfüllen, die mehr Fachwissen oder Genauigkeit erfordern als große Sprachmodelle. Zum Beispiel kann OpenAI Codex Computercode aus natürlichsprachlichen Beschreibungen generieren2, GPT-3 Ada kann hochwertige medizinische Texte schreiben3 und BERT-base-NER kann benannte Entitäten in Texten erkennen.

Feinabgestimmte Sprachmodelle sind leistungsstark, haben aber auch einige Nachteile. Sie erfordern mehr Daten und Fachwissen als große Sprachmodelle. Sie können sich auch zu stark an die Aufgaben- oder Domänendaten anpassen und verlieren dadurch einen Teil der Generalisierungsfähigkeit großer Sprachmodelle. Außerdem können sie immer noch unter einigen der Verzerrungen und Fehler großer Sprachmodelle leiden.

Edge-Sprachmodelle

Edge-Sprachmodelle sind die Leichtgewichte in der Welt der Sprachmodellierung. Sie sind so konzipiert, dass sie auf Geräten mit begrenzten Rechenressourcen wie Smartphones, Tablets oder Smartwatches laufen. Edge-Language-Modelle verwenden kleinere neuronale Netze mit weniger Schichten und Parametern, um natürlichsprachliche Texte zu erzeugen.

Die bekanntesten Beispiele sind TinyBERT, MobileBERT und DistilGPT-2. Diese Modelle können Aufgaben erfüllen, die eine schnelle und lokale Verarbeitung von natürlichem Text erfordern. TinyBERT kann zum Beispiel Fragen auf mobilen Geräten beantworten, MobileBERT kann Bildunterschriften für Tablets erstellen und DistilGPT-2 kann kurze Texte auf Smartwatches schreiben.

Edge-Sprachmodelle sind zweifellos praktisch, aber sie stellen auch eine Herausforderung dar, da die Optimierung ihrer Größe und Geschwindigkeit ohne Qualitätseinbußen mehr technischen Aufwand erfordert. Darüber hinaus bleiben sie bei einigen anderen Aufgaben hinter der Spitzenleistung großer oder fein abgestimmter Sprachmodelle zurück.

Warum Sprachmodelle wichtig sind

Sprachmodelle sind wichtig, weil sie es uns ermöglichen, mit Computern auf natürliche Weise zu kommunizieren. Sie ermöglichen uns auch einen einfacheren und effizienteren Zugang zu Informationen. Und sie inspirieren uns zu neuen Formen der Kunst und des Ausdrucks.

Stellen Sie sich vor, Sie planen eine Reise nach Paris und möchten das beste Hotel, den günstigsten Flug und die interessantesten Sehenswürdigkeiten finden. Sie könnten Stunden damit verbringen, verschiedene Websites zu durchforsten, Preise zu vergleichen, Bewertungen zu lesen und Reservierungen vorzunehmen. Oder Sie beauftragen ein Sprachmodell, das all dies in wenigen Minuten für Sie erledigt.

Sprachmodelle sind nicht nur für Reisende nützlich, sondern für jeden, der mit anderen kommunizieren oder Informationen abrufen muss. Sie können uns helfen, Geschichten zu recherchieren und zu schreiben, aber auch neue Sprachen zu lernen.

Sie bergen jedoch auch einige Risiken, die wir angehen müssen. Sie können leicht falsche oder schädliche Informationen erzeugen, die uns falsch informieren oder manipulieren, oder sie können bestehende soziale Ungleichheiten verstärken oder neue schaffen, indem sie bestimmte Personengruppen ausschließen oder diskriminieren.

Wir müssen uns über die Möglichkeiten und Grenzen der verschiedenen Arten von Sprachmodellen im Klaren sein, um sie verantwortungsvoll und ethisch vertretbar einzusetzen. Und wir müssen eine kontinuierliche konstruktive Zusammenarbeit und einen Dialog mit Forschern, Entwicklern, politischen Entscheidungsträgern und Nutzern von Sprachmodellen führen.